在人工智能正在彻底改变从创意头脑风暴到复杂系统建模的每一个领域的时代,数据隐私、偏见和问责制等问题日益突出。此时,视觉范式应运而生——作为可视化建模与绘图工具领域的先驱,它不仅乘上了AI的浪潮,更负责任地引领着这一浪潮。凭借一项强调伦理、透明度和用户控制的坚实AI政策,视觉范式不仅仅是一个供应商;它更是一位致力于赋能专业人士而不牺牲信任的合作伙伴。本文深入剖析了公司的AI政策,通过真实案例揭示其核心要素,并探讨为何视觉范式数十年的卓越传承和庞大的客户基础,使其成为人工智能驱动工具的可信赖之选。

卓越传承:视觉范式的历程

2001年,由Curtis Tsang在香港创立的视觉范式国际有限公司,源于一个简单却深远的愿景:让软件开发人员、业务分析师和企业架构师能够轻松、高效且协作地进行可视化建模。作为软件工程专家,Tsang敏锐地察觉到现有工具的诸多缺陷——高昂的成本、陡峭的学习曲线以及与敏捷工作流程的有限集成。最初仅是一款专注于UML(统一建模语言)的小众工具,如今已发展为一个全面的软件套件,支持BPMN(业务流程模型与符号)、ERD(实体关系图)、SysML等多种标准,同时坚持开放标准,以推动创新。

到2004至2005年,视觉范式已崭露头角,斩获五项重要的IT行业大奖,其中包括亚太地区ICT应用与基础设施工具奖。其重大突破出现在2011年,荣获备受推崇的Dr. Dobb’s Jolt奖“设计、架构与规划工具”类别,进一步巩固了其“更快、更好、更便宜”解决方案的声誉。多年来,公司不断拓展全球业务,在亚洲、欧洲和北美设立办事处,用户群体已增长至全球超过32万名专业人士。

这一发展历程映射了软件开发领域更广泛的转变——从僵化的瀑布式方法转向敏捷、迭代的流程。视觉范式通过早期融入人工智能实现了适应,但始终秉持以人为本的理念。如今,公司总部位于香港,保持无外部融资和独立所有,使其能够优先考虑长期用户价值,而非短期投资者压力。这种自力更生的模式培育了强大韧性,使其能够实现如AI驱动的图表生成等创新,而无需像一些风险投资支持的竞争对手那样采取道德妥协。

全球领军者:客户群体与实际影响

视觉范式视觉范式的可信度并非抽象概念——它体现在其多元化的知名客户群体中。目前已有超过32万名用户信赖其产品,涵盖初创企业、咨询公司、财富500强巨头、高等院校以及政府机构。知名客户包括:Adobe用于创意工作流建模,苹果用于系统架构设计,AT&T用于电信流程优化,英特尔用于软硬件集成,NASA用于关键任务模拟,诺基亚用于移动应用开发,以及丰田用于精益制造图表。

这种广泛的应用充分体现了其多功能性。在学术界,麻省理工学院和斯坦福大学将其用于教授UML和BPMN,称赞其对初学者而言界面直观易用。政府机构,如美国退伍军人事务部,依赖它进行安全且合规的流程映射。企业如西门子将其与Jira集成,用于敏捷项目管理,通过从模型自动生成代码,将开发周期缩短高达30%。

用户评价生动展现了这种信任。一位大型银行前首席架构师Daniel Cabin称其为“程序规划的最佳解决方案”,并强调它如何简化了复杂金融系统的设计流程。项目顾问Luis Rodriguez表示:“仅用一小时,我就通过将业务图表转换为用例,捕捉了90%的用户需求——现在我同时处理四个项目。”在PeerSpot上,用户给予其4.1/5的评分,评价其适应性和成本效益,一位用户指出:“它能无缝支持本地和云仓库,使模型管理变得毫不费力。”Capterra也持相同观点,一位经验证的营销高管表示:“视觉范式遵循UML标准,确保图表专业美观,而非业余草图。”

这些故事并非特例,而是常态。截至2025年12月,视觉范式在业务流程设计工具领域的市场占有率已达4.9%,在用户满意度方面,其协作性和可扩展性超越了Visio等竞争对手。其免费学术版已赋能数万名学生,培养出一批具备专业能力的从业者,他们将这份信任带入职业生涯。

解读AI政策:伦理AI的蓝图

视觉范式AI可信度的核心在于其全面的AI政策,这是一套透明的框架,用于规范AI聊天机器人、图表生成器等产品中的所有嵌入式AI功能。该政策发布以契合GDPR等不断演进的法规要求,适用于数据处理、模型行为和用户责任等所有方面。接下来我们将全面解析,通过实际案例展示其在现实中的应用。

目的与范围:守护AI前沿

该政策涵盖所有服务中的数据收集/使用、AI功能限制以及客户职责。例如,在视觉范式在线平台中,文本转图表等AI工具均受此政策约束——确保每一次交互都符合伦理规范。这种广泛覆盖避免了信息孤岛,而不同于某些工具中AI功能分散在监管灰色地带的情况。

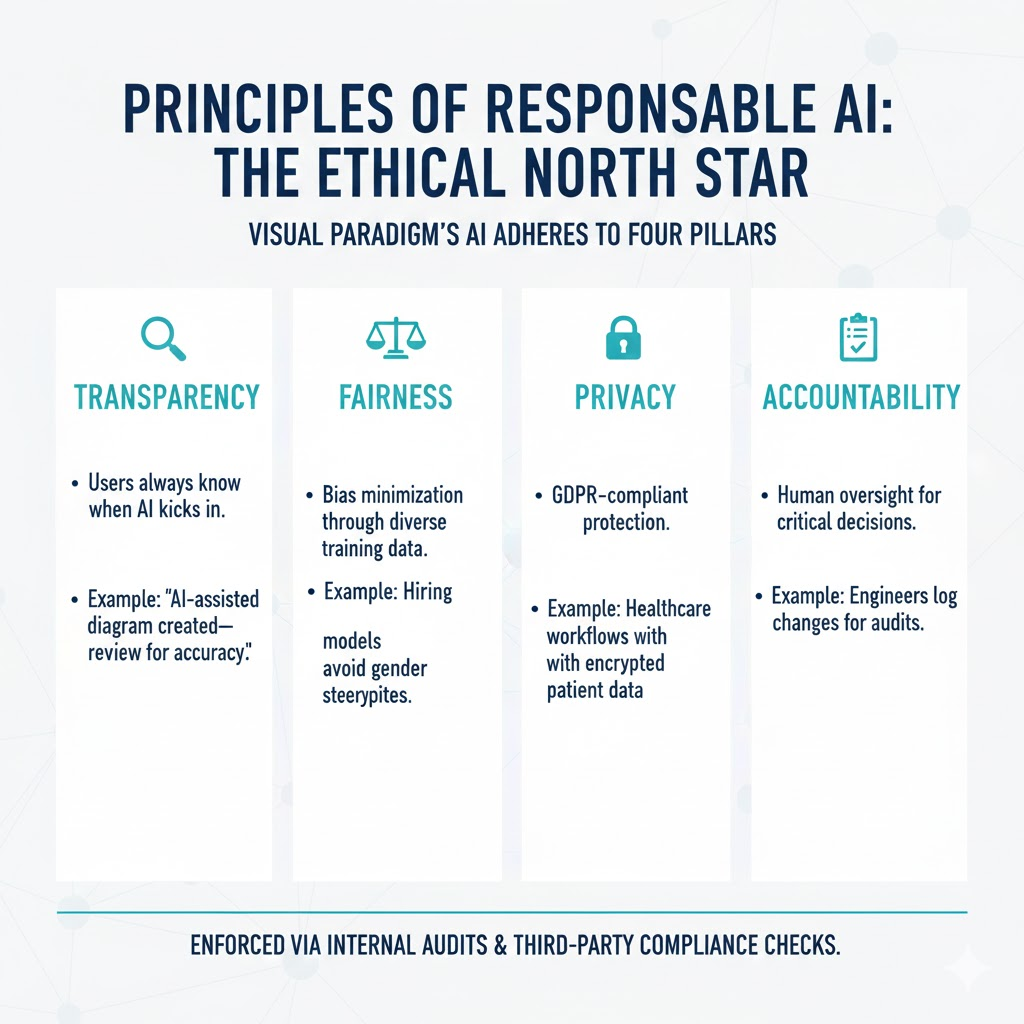

负责任AI的原则:伦理的北极星

视觉范式的AI遵循四大支柱:

- 透明性:用户始终清楚AI何时介入。例如,从“建模一个电子商务订单流程”这样的提示生成BPMN流程图时,系统会触发明确提示:“AI辅助生成图表——请审核准确性”。这揭开了“黑箱”的神秘面纱,增强了用户信心。

- 公平性:通过多样化训练数据实现偏见最小化。在招聘流程建模中,AI不会偏向性别刻板印象;相反,它基于均衡数据集生成结果,并提示用户验证结果的公平性。

- 隐私:符合GDPR的保护措施。所有数据均加密处理,严禁未经授权的共享。设想一家医疗公司绘制患者工作流程——敏感信息被严格锁定,仅可通过用户凭据访问。

- 问责制:关键决策需由人工监督。AI为航空航天模拟建议SysML模型,但工程师必须审批,并记录变更以备审计。

这些原则并非空谈,而是通过内部审计和第三方合规审查来严格执行。

AI能力与局限:设定合理预期

AI输出具有概率性——准确但并非万无一失。政策要求发出警告:“关键用途请审核自动化决策。”例如,在风险分析中,AI可能标记网络图中的漏洞,但可能忽略罕见网络威胁等边缘情况;此时需安全专家介入。即使模型基于多样化数据集训练,仍可能存在偏见风险——例如在全球供应链模型中过度强调西方商业惯例——因此建议用户多样化输入数据。

数据使用与隐私:你的数据,你的城堡

信任在此闪耀:Visual Paradigm不会不会使用客户数据或提示进行训练。通用功能(例如一次性生成UML)的提示/输出在会话结束后立即删除。对于AI聊天机器人,这些内容会保留至用户删除,从而支持像在数天内逐步完善用例这样的迭代式对话。

示例:一家初创公司输入提示:“为用户认证生成ERD。” 输出在导出后即消失,无法追溯用于训练。未经书面同意,绝不与第三方共享——这对诺基亚这类对知识产权敏感的企业建模5G架构至关重要。客户拥有其数据,可通过仪表板按钮随时请求删除。加密遵循隐私政策,并保留日志以应对安全事件。

用户提示与输出处理:短暂且安全

提示属于“短暂数据”——不会被存储、重复使用或在会话之外进行分析。示例:为进入市场进行SWOT分析头脑风暴?您输入的“分析教育科技发布的风险”提示生成图表后即消失——不会被用于数据分析挖掘。外部共享需经授权,防止在协作型企业环境中发生信息泄露。

客户责任:双向责任

用户必须遵守法律法规,避免有害用途(例如不得使用歧视性招聘模型),并提供反馈。示例:如果在多样性流程图中出现AI偏见,及时标记有助于优化公平性算法。

更新与修订:秉持诚信持续演进

政策发布后会静默更新,鼓励用户定期审查。这种敏捷性——如GDPR的微调——确保政策保持最新,同时不影响用户使用。

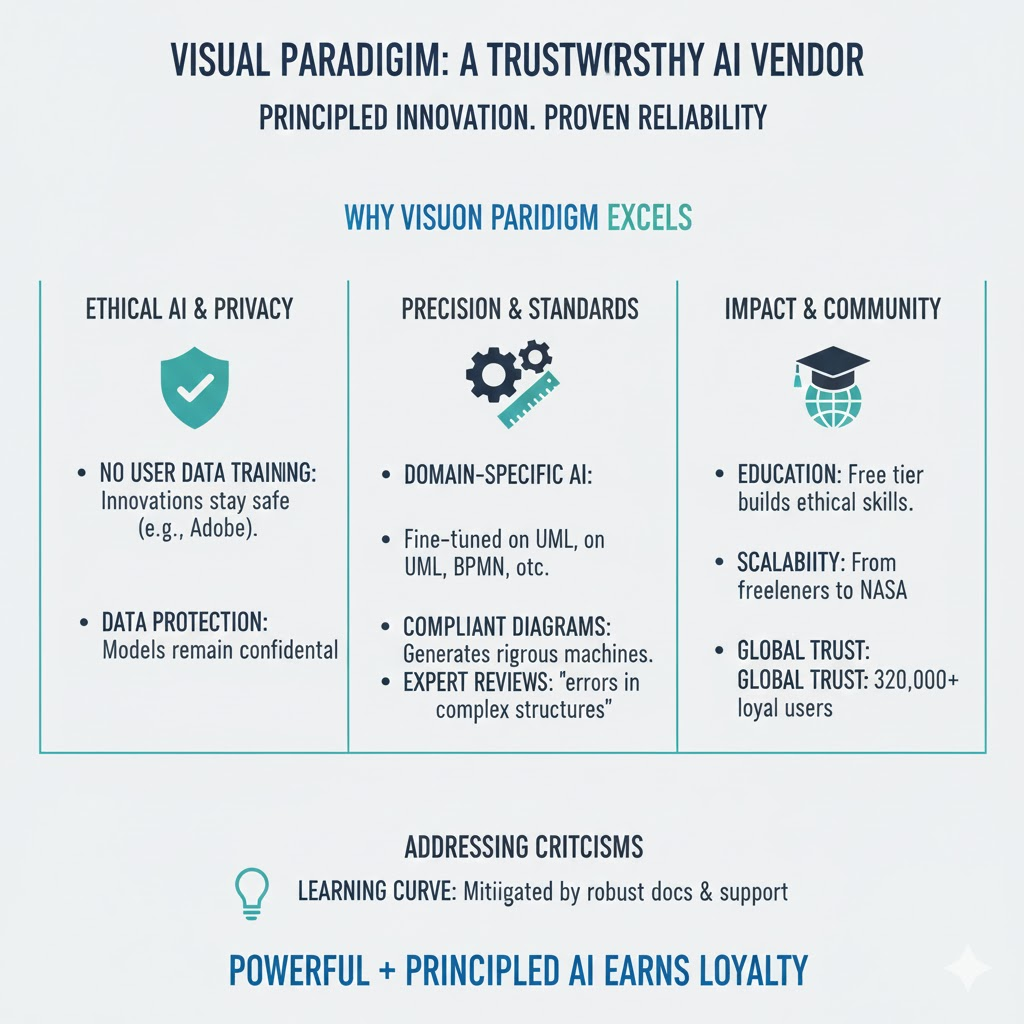

为何Visual Paradigm能成为值得信赖的AI供应商

Visual Paradigm的可信度源于一致性:其屡获殊荣的可靠性历史塑造了其AI伦理,其客户群体也验证了成果。与那些盲目追逐热度、随意收集数据的AI工具不同,Visual Paradigm坚持不使用用户数据进行训练,保护了创新成果——例如,Adobe的专有设计得以安全。AI聊天机器人基于UML等建模标准进行微调,生成符合规范的图表(例如包含推断转换的状态机),而非普通草图。评论者称赞道:“它遵循工程实践,减少了复杂结构中的错误。”

在教育领域,其免费版本以合乎伦理的方式培养技能,正如一位教授所言:“它不会妨碍面向对象语义的教学——学生能专注于概念。” 可扩展性同样出色:从个人自由职业者绘制应用程序图表,到NASA的模拟系统,它都能灵活适应,同时不牺牲隐私。

批评者可能会指出高级AI功能存在学习曲线,但完善的文档和支持(因其快速响应而受到赞誉)缓解了这一问题。最终,Visual Paradigm证明了AI可以既强大又且秉持原则——赢得了超过32万用户的支持,他们更看重安全而非速度。

结论:以使命为伴

Visual Paradigm不仅仅是一家AI工具供应商;它更是负责任创新的守护者。其政策将抽象的伦理转化为切实的保护措施,依托于24年的卓越历史和覆盖苹果等创新者到全球教育者的客户生态。无论您是在建模丰田生产线,还是设计大学课程,Visual Paradigm都能确保您的工作安全、公正且具有前瞻性。在充满不信任的AI环境中,它是您值得信赖的合作伙伴——因为信任,如同精心绘制的图表,经得起时间考验。立即探索他们的工具,了解为何全球专业人士选择可靠性而非风险。