در زمانی که هوش مصنوعی همه چیز از ذهنزنی خلاقانه تا مدلسازی سیستمهای پیچیده را دگرگون میکند، نگرانیهایی درباره حریم خصوصی دادهها، سوگیری و پاسخگویی به شدت افزایش یافته است. ویژوال پارادایم وارد میشود، یک پیشگام در ابزارهای مدلسازی و نمودارسازی بصری که نه تنها در موج هوش مصنوعی سوار شده، بلکه آن را به صورت مسئولانه هدایت میکند. با سیاست هوش مصنوعی قوی که اخلاق، شفافیت و کنترل کاربر را در اولویت قرار میدهد، ویژوال پارادایم تنها یک تأمینکننده نیست؛ بلکه همکاریای است که به حمایت از حرفهایان بدون تضعیف اعتماد پایبند است. این مقاله به بررسی عمیق سیاست هوش مصنوعی شرکت میپردازد، عناصر کلیدی آن را با مثالهای واقعی تحلیل میکند و بررسی میکند که چرا تاریخچه دههها ایشان و پایگاه مشتریان گستردهای که دارد، آن را به انتخابی قابل اعتماد برای ابزارهای پشتیبانی از هوش مصنوعی تبدیل کرده است.

تاریخچهای از عظمت: تاریخچه ویژوال پارادایم

ویژوال پارادایم انترنشنال لیمیتد در سال ۲۰۰۱ توسط کورتیس تسانگ در هنگ کنگ تأسیس شد و از یک دیدگاه ساده اما عمیق به وجود آمد: اینکه مدلسازی بصری برای توسعهدهندگان نرمافزار، تحلیلگران کسبوکار و مهندسان سازمانی قابل دسترس، کارآمد و همکارانه باشد. تسانگ، متخصص مهندسی نرمافزار، شکافهای موجود در ابزارهای فعلی را تشخیص داد—هزینههای بالا، منحنی یادگیری تند و ادغام محدود با فرآیندهای آگیل. ابزاری که ابتدا به عنوان یک ابزار تخصصی UML (زبان مدلسازی یکپارچه) شروع شد، به یک مجموعه جامع تبدیل شده که از BPMN (نمادگذاری و مدلسازی فرآیند کسبوکار)، ERD (نمودارهای رابطه موجودیت)، SysML و بیشتر پشتیبانی میکند، در حالی که استانداردهای باز را به عنوان محرک نوآوری پذیرفته است.

تا سال ۲۰۰۴-۲۰۰۵، ویژوال پارادایم از اولین موارد توجه بود و پنج جایزه مهم صنعت فناوری اطلاعات، از جمله جایزه آسیا پاسیفیک ICT برای ابزارهای برنامهها و زیرساختها، کسب کرد. نقطه عطف آن در سال ۲۰۱۱ با دریافت جایزه معتبر دکتر دابز جولت در دسته ابزارهای طراحی، معماری و برنامهریزی بود که اعتبار آن را برای ارائه راهحلهای «سریعتر، بهتر و ارزانتر» تثبیت کرد. در طول سالها، شرکت به صورت جهانی گسترش یافت و د vănدهایی در آسیا، اروپا و آمریکای شمالی ایجاد کرد و پایگاه کاربران خود را به بیش از ۳۲۰٬۰۰۰ حرفهای در سراسر جهان رساند.

این تحول، تغییر گستردهتر در توسعه نرمافزار را منعکس میکند—از روشهای سفت و سخت آبشاری به فرآیندهای آگیل و تکراری. ویژوال پارادایم با ادغام هوش مصنوعی از ابتدا بهطور مناسب پاسخ داد، اما همیشه با اصل متمرکز بر انسان. امروزه با دفتر مرکزی در هنگ کنگ، بدون سرمایهگذاری و به صورت مستقل مالکیت دارد، که به آن امکان میدهد ارزش کاربران بلندمدت را نسبت به فشارهای کوتاهمدت سرمایهگذاران اولویت دهد. این رویکرد خودکفایی، استحکام را تقویت کرده و امکان نوآوریهایی مانند تولید نمودارهای مبتنی بر هوش مصنوعی را فراهم کرده است، بدون اینکه از مسیرهای اخلاقی کوتاهتری که در برخی رقبای وابسته به سرمایهگذاری دیده میشود، استفاده کند.

یک قدرت جهانی: پایگاه مشتریان و تأثیر واقعی در دنیای واقعی

ویژوال پارادایماعتماد ویژوال پارادایم مفهومی مبهم نیست—این امر در پایگاه مشتریان متنوع و بزرگمقیاس آن ثابت شده است. بیش از ۳۲۰٬۰۰۰ کاربر به آن اعتماد دارند و این پایگاه شامل استارتاپهای کوچک، مشاورهها، شرکتهای فورچون ۵۰۰، دانشگاهها و نهادهای دولتی است. موارد پرطرفدار شامل آدوبی برای مدلسازی فرآیندهای خلاقانه، اپل برای طراحی معماری سیستم، AT&T برای بهینهسازی فرآیندهای تلفنی، اینتل برای ادغام سختافزار و نرمافزار، ناسا برای شبیهسازیهای حیاتی، نوکیا برای توسعه برنامههای موبایل و تایوتا برای نمودارهای تولید لئن است.

این گستردگی، انعطافپذیری آن را نشان میدهد. در حوزه آموزشی، دانشگاههایی مانند MIT و استنفورد از آن برای آموزش UML و BPMN استفاده میکنند و از رابط کاربری آسان آن برای یادگیرندگان تازهکار تقدیر میکنند. دولتها، از جمله وزارت ویترانهای آمریکا، از آن برای نقشهبرداری فرآیندهای امن و مطابق با قوانین استفاده میکنند. شرکتهای بزرگی مانند سیمنس آن را با جایرا برای مدیریت پروژههای آگیل ادغام کردهاند و با تولید خودکار کد از مدلها، چرخه توسعه را تا ۳۰ درصد کاهش دادهاند.

گواهیها تصویری زنده از این اعتماد ارائه میدهند. دانیل کابین، معمار ارشد سابق یک بانک بزرگ، آن را «بهترین راهحل برای برنامهریزی پروژه» نامید و تأکید کرد که چگونه طراحیهای پیچیده سیستمهای مالی را سادهتر کرده است. لوئیس رودریگو، مشاور پروژه، گفت: «در یک ساعت، ۹۰ درصد نیازهای کاربر را با تبدیل نمودارهای کسبوکار به موارد مورد استفاده ثبت کردم—حالا همزمان چهار پروژه را مدیریت میکنم.» در پیراساپ، کاربران آن را با نمره ۴٫۱ از ۵ برای انعطافپذیری و اثربخشی هزینه ارزیابی کردهاند، و یک نظردهنده افزود: «این ابزار به صورت بیدردسر از مخازن محلی و ابری پشتیبانی میکند و مدیریت مدلها را آسان میکند.» کاپترا نیز این نظر را تکرار میکند، با اینکه یک مدیر بازاریابی تأییدشده گفت: «ویژوال پارادایم از استانداردهای UML پیروی میکند و اطمینان حاصل میشود که نمودارها حرفهای به نظر برسند—نه مانند نقاشیهای آماتور.»

این داستانها نمونههای بینظیر نیستند؛ بلکه معمول هستند. با نسبت ۴٫۹ درصدی در ابزارهای طراحی فرآیند کسبوکار تا دسامبر ۲۰۲۵، ویژوال پارادایم در رضایت کاربران از همکاری و قابلیت گسترش، رقیبهایی مانند ویزیو را پشت سر میگذارد. نسخه آموزشی رایگان آن هزاران دانشجو را توانمند کرده و مسیری از حرفهایان ماهر ایجاد کرده که این اعتماد را به مسیر شغلی خود منتقل میکنند.

تشریح سیاست هوش مصنوعی: نقشه راهی برای هوش مصنوعی اخلاقی

در قلب اعتماد ویژوال پارادایم به هوش مصنوعی، سیاست جامع هوش مصنوعی آن قرار دارد، یک چارچوب شفاف که تمام ویژگیهای هوش مصنوعی داخلی در محصولاتی مانند چتبات هوش مصنوعی و تولیدکننده نمودارها را تنظیم میکند. این سیاست با هماهنگی با مقررات در حال تکامل مانند GDPR منتشر شده و به طور جهانی در مورد مدیریت دادهها، رفتار مدل و مسئولیتهای کاربران اعمال میشود. بیایید آن را به طور جامع تحلیل کنیم و با مثالهایی از کاربردهای واقعی آن، آن را روشن کنیم.

هدف و دامنه: محافظت از مرزهای هوش مصنوعی

این سیاست شامل جمعآوری/استفاده از دادهها، محدودیتهای هوش مصنوعی و مسئولیتهای مشتری در تمام خدمات است. به عنوان مثال، در ویژوال پارادایم آنلاین، ابزارهای هوش مصنوعی مانند تبدیل متن به نمودار در این دامنه قرار دارند—تا اطمینان حاصل شود که هر تعامل با اصول اخلاقی تنظیم شده باشد. این دامنه گسترده، جلوی ایجاد حوزههای جدا شده را میگیرد، در حالی که در برخی ابزارها سیاستهای پراکندهای وجود دارند که ویژگیهای هوش مصنوعی در مناطق نامشخص قانونی عمل میکنند.

اصول هوش مصنوعی مسئولانه: ستاره راهنمای اخلاقی

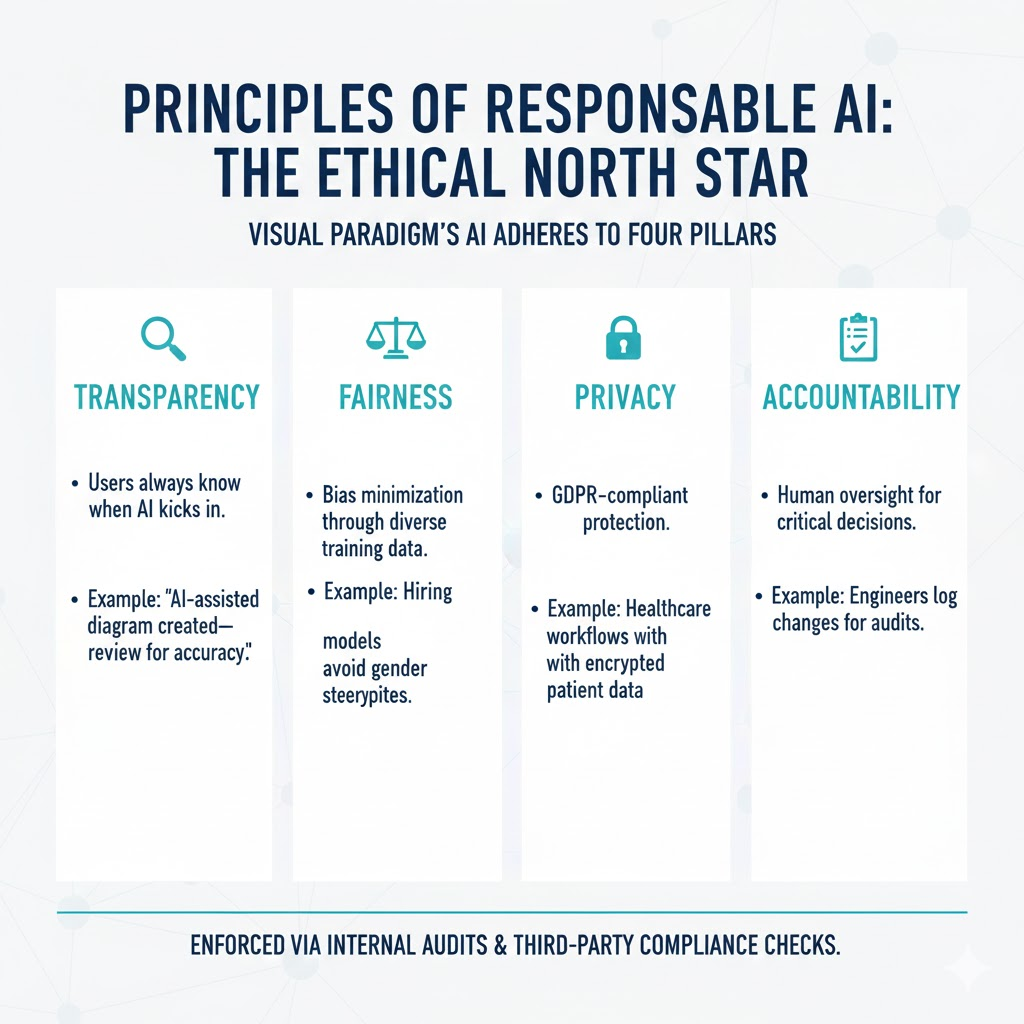

هوش مصنوعی ویژوال پارادایم به چهار ستون اصلی پایبند است:

- شفافیت: کاربران همیشه میدانند که هوش مصنوعی فعال شده است. مثال: تولید یک نمودار جریان BPMN از طریق پیامی مانند «مدلسازی فرآیند سفارش اینترنتی» باعث ایجاد اعلان واضح میشود: «نمودار کمکشده توسط هوش مصنوعی ایجاد شده—برای دقت بررسی شود.» این کار جادویی «جعبه سیاه» را از بین میبرد و اعتماد را افزایش میدهد.

- عدالت: کاهش سوگیری از طریق دادههای آموزشی متنوع. در مدلسازی فرآیند استخدام، هوش مصنوعی به سوگیریهای جنسیتی نمیپردازد؛ بلکه از مجموعههای داده متوازن استفاده میکند و کاربران را به بررسی نتایج متعادل تشویق میکند.

- حریم خصوصی: محافظت مطابق با GDPR. تمام دادهها رمزنگاری شدهاند و به هیچ وجه به صورت غیرمجاز به اشتراک گذاشته نمیشوند. فرض کنید یک شرکت بهداشتی فرآیندهای بیماران را مدل میکند—جزئیات حساس در بستهبندی باقی میمانند و تنها از طریق اعتبار کاربر قابل دسترسی هستند.

- پاسخگویی: نظارت انسانی بر تصمیمات حیاتی. هوش مصنوعی یک مدل SysML برای شبیهسازیهای فضایی پیشنهاد میکند، اما مهندسان باید آن را تأیید کنند و تغییرات را ثبت کنند تا برای بازبینی قابل دسترس باشند.

این اصول فقط کلامی نیستند؛ بلکه از طریق بازبینیهای داخلی و بررسیهای سومینطرفه مطابق با قوانین اجرا میشوند.

تواناییها و محدودیتهای هوش مصنوعی: تعیین انتظارات واقعبینانه

خروجیهای هوش مصنوعی احتمالی هستند—دقیق اما قابل اشتباه. سیاست این امر را الزام میکند: «تصمیمات خودکار را برای استفاده حیاتی بررسی کنید.» مثال: در تحلیل ریسک، هوش مصنوعی ممکن است آسیبپذیریهایی در نمودار شبکه را مشخص کند اما موارد لبهای مانند تهدیدهای سایبری نادر را نادیده بگیرد؛ یک متخصص امنیت وارد میشود. مدلها که بر روی مجموعههای داده متنوع آموزش دیدهاند، همچنان خطرات سوگیری را دارند—مثلاً تأکید بیش از حد بر نمایههای کسبوکار غربی در مدلهای زنجیره تأمین جهانی—بنابراین کاربران تشویق میشوند تا ورودیهای خود را متنوع کنند.

استفاده از دادهها و حریم خصوصی: دادههای شما، قلعه شما

اینجا است که اعتماد بدرخشش میکند: ویژوال پارادایمنیستاز دادههای مشتری یا پرسشها برای آموزش استفاده نمیکند. پرسشها/خروجیهای ویژگیهای کلی (مثلاً تولید یکباره UML) بلافاصله پس از جلسه حذف میشوند. برای چتبات هوش مصنوعی، تا زمانی که کاربر آنها را حذف نکند، نگهداری میشوند و امکان چتهای مکرر مانند بهبود یک مورد استفاده در طول چند روز را فراهم میکنند.

مثال: یک استارتآپ پرسش میکند: «ERD مربوط به احراز هویت کاربر را تولید کن.» خروجی پس از صدور حذف میشود و برای آموزش ردیابی نمیشود. بدون مجوز نوشتهشده، به هیچ سومی نمیشود اشتراک گذاشت—این امر برای شرکتهای حساس به مالکیت فکری مانند نوکیا که معماری 5G را مدل میکنند، حیاتی است. مشتریان مالک دادههای خود هستند و میتوانند در هر زمان از طریق یک دکمه در داشبورد درخواست حذف کنند. رمزنگاری مطابق با سیاست حریم خصوصی انجام میشود و لاگها برای اثبات عدم نقض امنیتی نگهداری میشوند.

مدیریت پرسش و خروجی کاربر: موقت و ایمن

پرسشها نوعی دادههای موقت هستند—ذخیره نمیشوند، دوباره استفاده نمیشوند یا فراتر از جلسه تحلیل نمیشوند. مثال: در حال تولید ایده برای تحلیل SWOT برای ورود به بازار؟ پرسش شما «تحلیل ریسکهای مربوط به راهاندازی edtech» یک نمودار تولید میکند و سپس ناپدید میشود—هیچ کاوشی در دادهها انجام نمیشود. اشتراکگذاری خارجی نیازمند مجوز است و از نشت اطلاعات در محیطهای شرکتی همکارانه جلوگیری میکند.

مسئولیتهای مشتری: یک جاده دوطرفه

کاربران باید قوانین را رعایت کنند، از استفادههای مضر جلوگیری نمایند (مثلاً استفاده از مدلهای استخدام تبعیضآمیز)، و بازخورد ارائه دهند. مثال: اگر سوگیریهای هوش مصنوعی در یک نمودار تنوع ظاهر شود، اعلام آن به بهبود الگوریتمهای عدالت کمک میکند.

بهروزرسانیها و بازنگریها: پیشرفت با انصاف

این سیاست بهصورت بیصدا پس از انتشار بهروزرسانی میشود و از بازبینی دورهای توسط کاربران تشویق میکند. این انعطافپذیری—که در تنظیمات GDPR مشهود است—به آن امکان میدهد بدون اختلال در کاربران بهروز بماند.

چرا ویژوال پارادایم در نقش یک فروشنده هوش مصنوعی مورد اعتماد برتر است

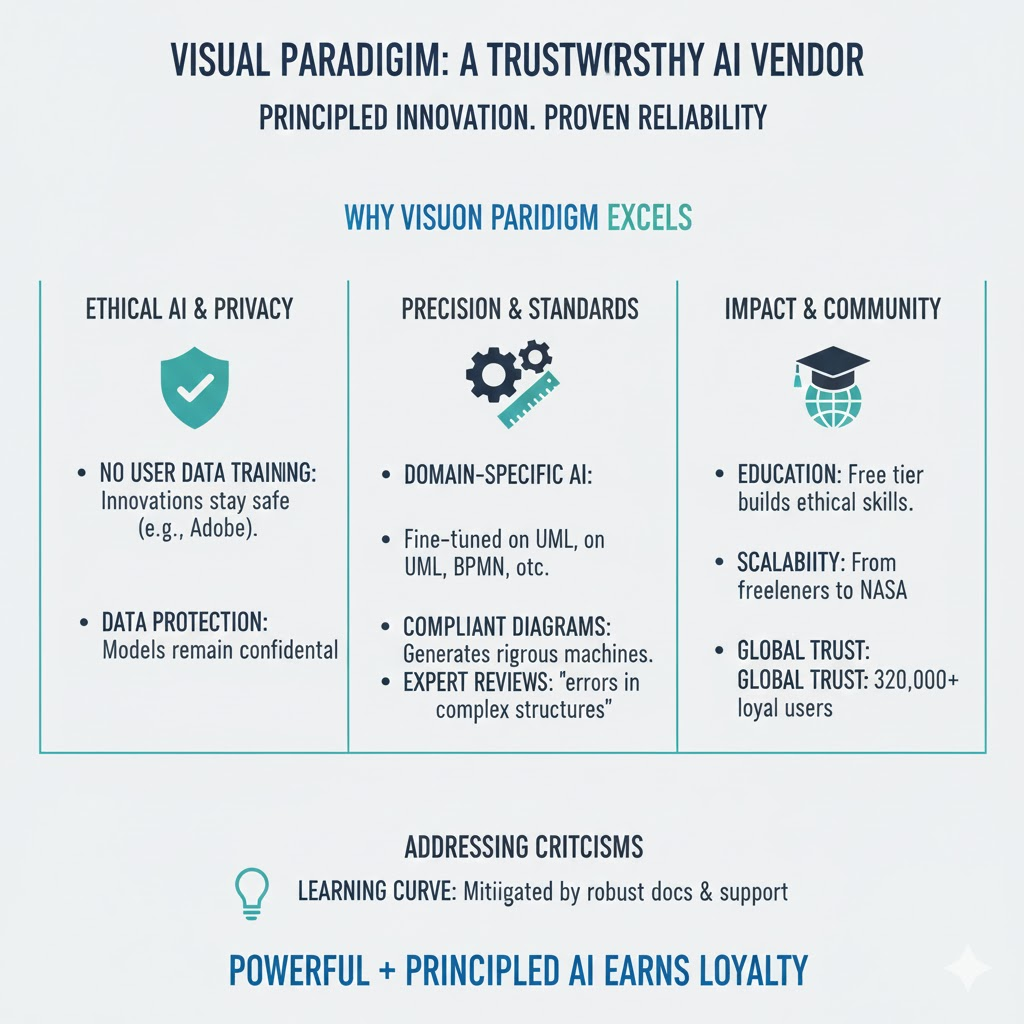

اعتماد به ویژوال پارادایم از هماهنگی ناشی میشود: تاریخچه موفقیتآمیز و قابل اعتماد آن، اخلاق هوش مصنوعی را هدایت میکند و جمعیت مشتریان نتایج را تأیید میکنند. در مقابل ابزارهای هوش مصنوعی که به دلیل هیپها دادهها را به صورت بیتفاوت جمعآوری میکنند، نگرش ویژوال پارادایم که از آموزش بر روی دادههای کاربران خودداری میکند، نوآوریها را حفظ میکند—مثلاً طرحهای اختصاصی آدوبی ایمن میمانند. چتبات هوش مصنوعی، که با استانداردهای مدلسازی مانند UML تنظیم شده، نمودارهای مطابق با استانداردها (مثلاً ماشینهای حالت با انتقالهای نتیجهگیری شده) تولید میکند، نه نقاشیهای کلی. نظرات بررسیکنندگان این موضوع را تحسین میکنند: «این از رویههای مهندسی پیروی میکند و خطاها در ساختارهای پیچیده را کاهش میدهد.»

در آموزش، نسخه رایگان آن مهارتها را اخلاقی ایجاد میکند، همانطور که یک استاد گفت: «این آموزش مفاهیم شیگرا را مختل نمیکند—دانشآموزان بر روی مفاهیم تمرکز میکنند.» قابلیت مقیاسپذیری نیز برجسته است: از آزادکاران تکنفره که برنامهها را مدل میکنند تا شبیهسازیهای ناسا، بدون آسیب به حریم خصوصی تطبیق مییابد.

انتقادات ممکن است به شیب یادگیری برای ویژگیهای پیشرفته هوش مصنوعی اشاره کنند، اما مستندات قوی و پشتیبانی (که برای پاسخهای سریع تحسین شدهاند) این مسئله را کاهش میدهد. در نهایت، ویژوال پارادایم ثابت میکند که هوش مصنوعی میتواند قدرتمند باشدوو اصولی—وفاداری بیش از 320,000 کاربر را کسب کرده که امنیت را بر سرعت ترجیح میدهند.

نتیجهگیری: شریک شدن با هدف

ویژوال پارادایم تنها یک فروشنده ابزار هوش مصنوعی نیست؛ بلکه نگهبان نوآوری مسئولانه است. سیاست آن اخلاقهای مبهم را به اقدامات عملی و ایمنی تبدیل میکند، با پشتیبانی از تاریخ 24 ساله نوآوری و یک اکوسیستم مشتری که از نوآورانی مانند اپل تا معلمان جهان گسترده است. چه در مدلسازی خط تولید تایوتا و چه در طراحی سرفصل دانشگاهی، ویژوال پارادایم اطمینان میدهد که کار شما ایمن، عادلانه و پیشرو است. در یک محیط هوش مصنوعی که اعتماد کم است، این فروشنده است که میتوانید به آن اعتماد کنید—چون اعتماد، همانند یک نمودار بهدرستی طراحی شده، برای مدت طولانی ساخته میشود. امروز ابزارهای آن را بررسی کنید و ببینید چرا متخصصان جهانی اعتماد را برای ریسک انتخاب میکنند.

This post is also available in Deutsch, English, Español, Français, English, Bahasa Indonesia, 日本語, Polski, Portuguese, Ру́сский, Việt Nam, 简体中文 and 繁體中文.